苹果6概念机|大模型“浮现”出来的思维链是一种怎样的能力?

听说大AI公司的开发者和高校的NLP研究者都在思考如何让大模型“浮现”。 莫名其妙的画面让我想到了程序员给服务器上香保佑它不要宕机。 有一种玄学,求天道。

大模型领域所谓的“涌现”,是指当模型突破一定规模后,性能显着提升,展现出惊人的、意想不到的能力。 比如语言理解能力、生成能力、逻辑推理能力等。一般来说,模型的参数量在100亿到1000亿之间,可能会导致能力的产生。

但俗话说,“氪不救飞,玄不改命”。 靠着花钱和运气,光是把模型越做越大,未必能让AI“现身”。

强大的逻辑推理是大语言模型“智能涌现”的核心能力之一,仿佛AI拥有了人类的意识。 推理能力的关键在于一项技术——Chain of (CoT)。

如果你看过类GPT应用的翻车问题,你会发现大部分都是数学算术问题、逻辑思维问题等,这些问题需要精准推理,而这正是思维链可以重点解决的。 训练大型语言模型的公司和机构很多,但能训练出思维链并应用的却寥寥无几。

也就是说,只有思维链技术解锁,大语言模型才能“脱颖而出”,才能在“大精化模型”的竞争中占据能力优势。

思链的故事始于一个奇怪的男人。

一个了不起的人

思维链,在人工智能领域,是一个非常非常新的概念。

2022年1月,它的相关论文被放到arxiv上,结果特别惊艳。 谷歌也在当年5月的年度开发者大会I/O 2022上公开了思维链的研究成果。 彼时,PaLM、Pixel系列手机大尺寸机型也同台推介。

你可能发现了华电,思维链是如何名扬全球的?

这就要提到一个奇怪的人——思维链的创造者Jason Wei。

之所以神奇,是因为我的本事极强。

这位2020年本科毕业成为谷歌大脑高级研究员的华人科学家,在任职期间提出了思维链的概念,发现思维链可以增强大型语言模型的推理能力。

(Jason Wei 个人博客)

二是他个人的经历,对AI影响很大。 2022年2月,离开谷歌加入团队。

那么这个奇怪的人和他的同事们到底做了什么工作呢?

谷歌之前在大模型上下功夫。 GPT生成式预训练模型中的“T”,也就是 Brain创造的。 但是经过几年的大模型预训练+微调,仍然没有办法完成多步推理任务苹果6概念机,比如数学题和常识推理。

于是Jason Wei等人提出了思维链提示的方法,一下子真正改变了大模型的逻辑推理能力。

具体来说,有以下三个区别:

1、常识推理能力超越人类。 之前的语言模型在很多具有挑战性的任务中无法达到人类水平,但是使用思维提示链的大型语言模型在 Bench Hard (BBH) 评估基准的 23 个任务中的 17 个中表现良好。 在人类的基线上。

例如,常识性推理包括对身体和交互的理解,而在运动理解方面,思维链的表现超过了运动爱好者(95% vs 84%)。

(思想链突出显示)

2. 数学逻辑推理能力有了很大的提高。

一般来说,语言模型在算术推理任务中表现不佳,但应用思维链后,大型语言模型的逻辑推理能力有了突飞猛进的提升。

GSM8K和GSM8K这两个数据集测试了语言模型解决数学问题的能力,通过思维链的提醒,PaLM这种大型语言模型的性能比传统的 提升了300%!

GSM8K 上的性能提升是巨大的,甚至超过了监督学习的最佳性能。

这意味着大型语言模型也可以解决需要精确、逐步计算的复杂数学问题。

3. 大型语言模型可解释性更强,可信度更高。

我们知道,在超大规模无监督深度学习中,创建的大模型是一个黑盒子,推理和决策链是不可知的,这会让模型结果不那么可信。

思维链将一个逻辑推理问题分解成多个步骤逐个进行,使生成的结果具有更清晰的逻辑联系,并提供一定程度的可解释性,让人知道答案是怎么来的。

奇人Jason Wei提出的思维链,可以说是大语言模型这个神奇世界的必要条件。

一个魔法咒语

花式调侃一下大语言模型,有个很神奇的咒语可以让LLM的答案大不同,那就是——“Let's think step by step”。

很多用户之前已经发现,一旦你在问题中加上“让我们一步步思考”,它就好像被施了魔法一样。 原本做错的数学题,突然就做成了; 原本的废话一下子变得有道理了。 向上。

这就是思维链的魔力。

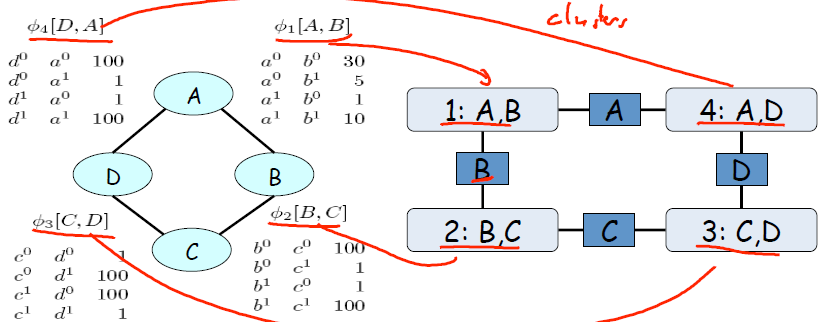

思维链(Chain-of-,CoT)是指一系列的逻辑思维步骤,形成一个完整的思维过程。

在日常生活中,人们随时随地利用思维链来解决问题。 比如工作和阅读中经常使用的思维导图,就是在不忽略重要细节的情况下,尽可能全面地拆解步骤,从而充分考虑问题。

这种步骤分解的方法用于提示学习,称为思维链提示。 它将大型语言模型的推理过程分解成步骤并直观地展示出来。 这样开发者就可以在LLM推理出现错误的时候,及时修复。

相当于让AI做分析题,而不是“填空题”。 推理过程一定要详细讲解,一步步打分,最后给出答案。

在 2022 年的论文中,Jason Wei 等人。 展示了标准提示学习和思维链提示之间的区别:

可以看出,对于类似的算术题,思维链提示在给出答案前会自动给出推理步骤:

“罗杰首先有 5 个球,2 罐 3 个网球等于 6,5 + 6 = 11”

“食堂有23个苹果,午餐用了20个,23-20=3;又买了6个苹果,3+6=9”

思维链提示给出正确答案,而传统的直报答案的提示学习给出错误答案,连小学水平的加减法都做不好。

简单来说,语言模型很难将所有的语义直接转化为一个等式,因为这是一个更复杂的思考过程,但它可以通过中间步骤更好地推理出问题的每一部分。

思维链提示就是把一个多步推理问题分解成很多中间步骤,分配更多的计算,产生更多的token,然后将这些答案拼接在一起求解。

再举个例子,大家都很希望有一个全能的家政机器人,但是现在的机器人似乎都比较笨,只能执行一些很简单的指令开灯关灯。 如果用户问,“我把可乐洒在桌子上了,你能把它扔掉并拿东西帮我清理一下吗?”

机器人应该做什么?

这时候就有了思维链的语言模型,会分析问题:用户把可乐洒在桌子上了。 我会把它扔掉,给用户一块海绵。

拆解步骤:找(可乐)、挑(可乐)、找(垃圾)、扔(可乐)、找(海绵)、挑(海绵)、找(桌子)、放(海绵)。

总的来说,思维链相当于让大语言模型做“因式分解”,将一个复杂的推理问题拆解,一步步解决。 自然更容易得到高质量的答案。

打破僵局的灵感

你可能会问,大语言模型的“智能涌现”需要思维链吗? 在这个阶段,确实如此。

由于预训练的大语言模型参数庞大,很容易被不相关的上下文分散注意力,影响性能。 相当于学生上课走神,被老师点名回答问题,只能胡说八道。 这时候就需要提示()进行微调,相当于被旁边的人提醒去更好的完成下游的任务。

然而,离散的硬提示( )需要人为设计的提示词,语言模型并不一定认为人类认为好的提示词就是好的。 最后,答案是一团糟。 而且使用离散的token作为提示词,优化难度特别高。 大的。

因此,连续软提示( ) 限制模型参数的调整,直接优化低维向量,这样可以通过小微调来提高模型性能。 这种方式省事效果也不错,但是这样走之后还是无法让语言模型理解逻辑推理。

思维链的提议使用离散的token,可以自动构建问题、推理步骤和样本,解决了人工设计离散提示的问题,也使得语言模型具有可解释性。

因此,思维链可以看作是打破大型语言模型能力僵局的神来之笔。 有时候技术的突破靠的是一个灵感,但是创造这个灵感的人才机制、创新环境、组织模式等需要很长时间的培养。

一些悬而未决的问题

说了这么多,难道真的有了思路链,大语言模型就无敌了吗? 如果再这样发展下去,真的能比得上人类的能力吗?

不用担心,思维链本身还是有很多局限性的,它的局限性也是大语言模型的局限性。

首先,当模型的规模足够大时,必须出现思维链。

在 Jason Wei 等人的研究中,PaLM 在扩展到 540B 参数时表现出先进的性能,并结合思想链提示。 对于一些小规模模型,思维链影响不大,能力提升不会很大。

谷歌大脑的研究人员认为,政策问题需要大量的世界知识,而小模型没有足够的参数来记忆这些世界知识,因此它们不太可能产生正确的推理步骤。

但问题是,能够应用于行业的模型规模必然不会太大。 思维链拆解了更多的步骤,使用了更多的计算资源,相当于更多的脑力。 许多研究机构和企业负担不起。 可以使用参数超过175B的大模型。

因此,思维链必须探索如何在更小的模型中进行推理,降低实际应用的成本。

62B语言模型比540B更容易出错

其次,思维链的应用领域有限。

目前,思维链只在一些有限的领域有效,比如数学问题,五个常识推理基准(,, Date and and)。 其他类型的任务,例如机器翻译,还有待评估。

此外,相关研究中使用的模型(GPT-3 API)或数据集是半公开或私有的,难以复制和验证。 严格来说,思维链的作用还需要进一步探究才能下定论。

另外,即使有了思维链的提醒,大语言模型仍然无法解决小学水平的数学问题。

没有思维链条,数学推理就无法具体化。 但是有了思路链,大型语言模型也可能出现误推,尤其是非常简单的计算错误。 在Jason Wei等人的论文中表明,在GSM8K的一个子集中,大语言模型有8%的计算误差,比如6 * 13 = 68(正确答案是78)。

这说明即使有了思路链,大语言模型仍然没有真正理解数理逻辑,不知道加减乘除的真正含义,只是用更精细的叠加来“挖勺子”葫芦”。 因此,对于有精确要求的任务,还要进一步探索新技术。

思维链确实增强了大语言模型的能力,但是逻辑推理仍然是大语言模型的薄弱环节,有待更多的突破。

还有一件事

通过思维链,我们可以看出大语言模型为什么强,为什么弱。

其优势在于模型规模的提升极大提升了语义理解、符号映射、连贯文本生成等能力,从而使多步推理的思维链成为可能,带来“智能涌现”。

它的弱点在于,尽管大语言模型展现出了前所未有的能力,但思维链条暴露了它苹果6概念机,它仍然是鹦鹉学舌而不是真正的意识。

认知心理学教授斯坦尼斯拉斯·迪昂( Dieng)在《精确学习》中指出,缓慢、理性、象征性地运作是人脑的特权。 它可以尽可能地提炼出普遍的、合乎逻辑的、清晰的原则。

五、六岁的孩子能理解小数相加的意义,并能运用在大数相加中。 目前最强大的大型语言模型连“加法”这种简单的抽象规律都看不懂。 无法理解。

这并不是让大家低估AI的能力,而是说明人脑和AI各有所长。

大语言模型,正如科幻小说作家姜泰德所说,是互联网上所有文本的模糊图像,有损压缩的JPEG,但它可以使用比人脑多得多的计算能力和数据来做一个好的工作在文本生成,图像生成这样的模糊任务。 人脑更擅长精确、合乎逻辑的任务,正如 Ted Jiang 所说:“当你还有原始图片时,一张模糊的 JPEG 有多大用处?”

智能时代的生存策略,不是用自己的弱点去迎战AI的长处。 相反,利用人工智能的优势让你的长板更长; 利用人脑的精准度,让AI生成的模糊答案质量更高; 使用思路提示链使 LLM 生成更有效。

在《哈利波特》电影中,有一座“有求必应屋”,里面装满了人们需要的东西。 海伦娜这样描述:

如果你不得不问,你永远不会知道。 如果你知道,你只需要问。

如果你还需要问,你永远不会明白; 如果你明白,你只需要问。

人工智能解答一切问题的时代,是智者的天堂,愚人的地狱。 永远不要让 AI 替你思考。